【新智元导读】就在刚刚,网上也曾出现了一波复现 DeepSeek 的怒潮。UC 伯克利、港科大、HuggingFace 等纷纷顺利复现,只用强化学习,莫得监督微调,30 好意思元就能见证「啊哈时刻」!大家 AI 大模子,未必正在干与下一分水岭。

这些天,硅谷透顶处于中国公司带来的地面震余波中。

全好意思齐在急躁:是否大家东说念主工智能的中心也曾退换到了中国?

就在这当口,大家复现 DeepSeek 的一波怒潮也来了。

诚如 LeCun 所言:「这一次,恰是开源对闭源的告捷!」

在莫得顶级芯片的情况下,以极低资本芯片训出顽固性模子的 DeepSeek,或将胁迫到好意思国的 AI 霸权。

大模子比拼的不再是动辄千万亿好意思元的算力战。

OpenAI、Meta、谷歌这些大公司引以为傲的期间上风和高估值将会瓦解,英伟达的股价将起先动摇。

各样这些不雅点和连续,让东说念主不禁怀疑:数百亿好意思元开销,对这个行业确实必要吗?以致有东说念主说,中国量化基金的一群天才,将导致纳斯达克崩盘。

从此,大模子时期很可能会干与一个分水岭:超强性能的模子不再独属于算力巨头,而是属于每个东说念主。

30 好意思金,就能看到「啊哈」时刻

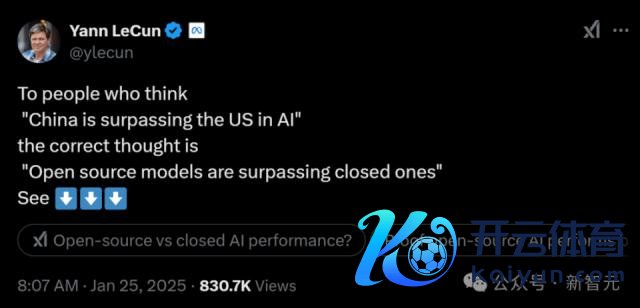

来自 UC 伯克利博士生潘家怡和另两位连续东说念主员,在 CountDown 游戏中复现了 DeepSeek R1-Zero。

他们示意,限度特殊出色!

实际中,团队考证了通过强化学习 RL,3B 的基础说话模子也能够自我考证和搜索。

更令东说念主得意的是,资本不到 30 好意思金(约 217 元),就可以亲眼见证「啊哈」时刻。

这个款式叫作念 TinyZero,接受了 R1-Zero 算法——给定一个基础说话模子、领导和真确奖励信号,运行强化学习。

然后,团队将其诳骗在 CountDown 游戏中(这是一个玩家使用基础算术运算,将数字组合以达到筹算数字的游戏)。

模子从领先的简便输出起先,冉冉进化出自我鼎新和搜索的战略。

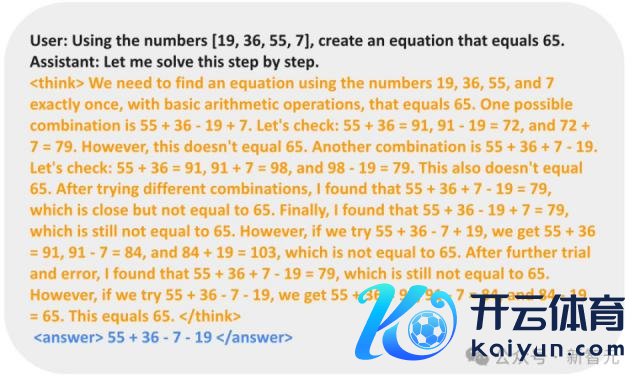

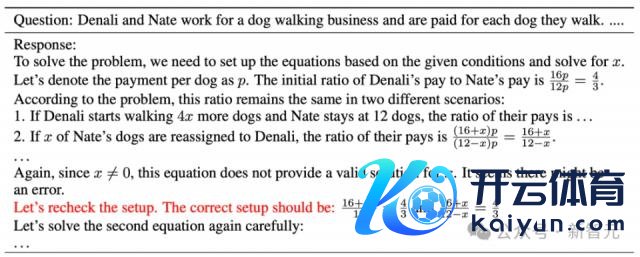

在以下示例中,模子建议了处治决策,自我考证,并反复鼎新,直到处治问题为止。

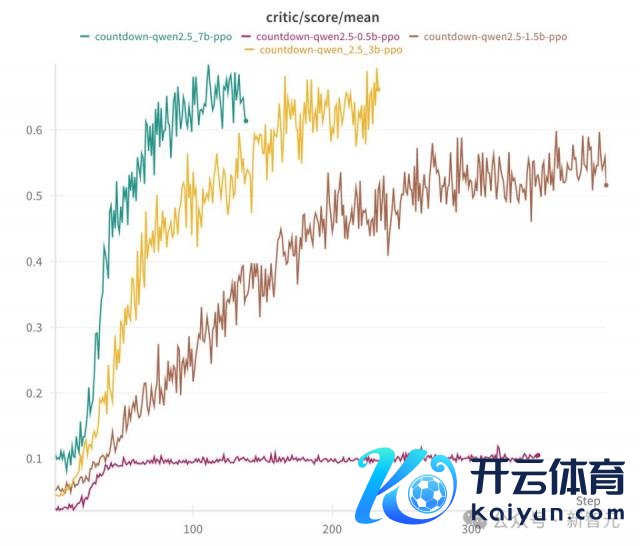

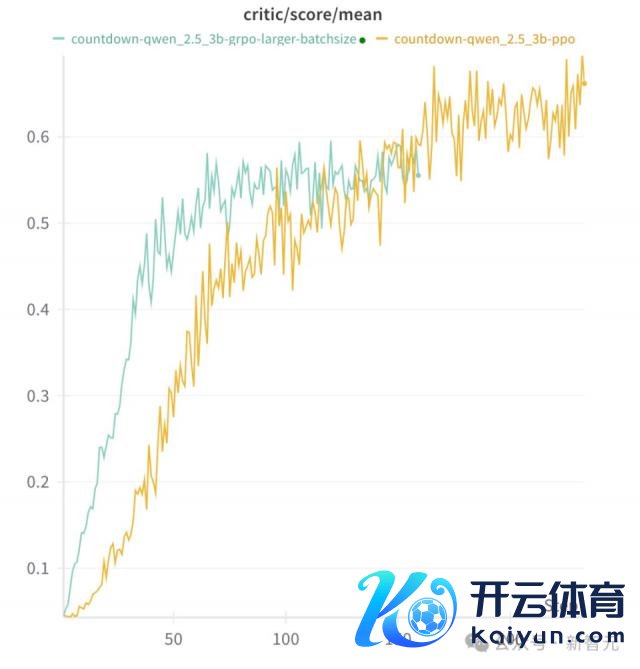

在消融实际中,连续东说念主员运行了 Qwen-2.5-Base(0.5B、1.5B、3B、7B 四种参数限度)。

限度发现,0.5B 模子只是是规齐整个处治决策然后罢手。而从 1.5B 起先,模子学会了搜索、自我考证和修正其处治决策,从而能够取得更高的分数。

他们以为,在这个过程,基础模子是性能的关节。

他们还考证了,零碎的指示微调(SFT)并非是必要的,这也印证了 R1-Zero 的遐想决策。

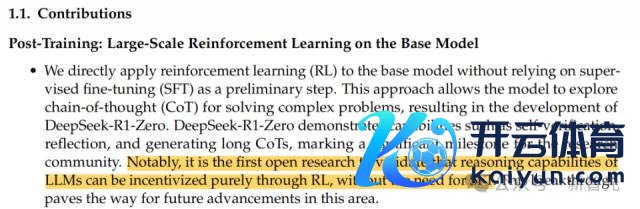

这是首个考证 LLM 推理才气的罢了可以贞洁通过 RL,无需监督微调的开源连续

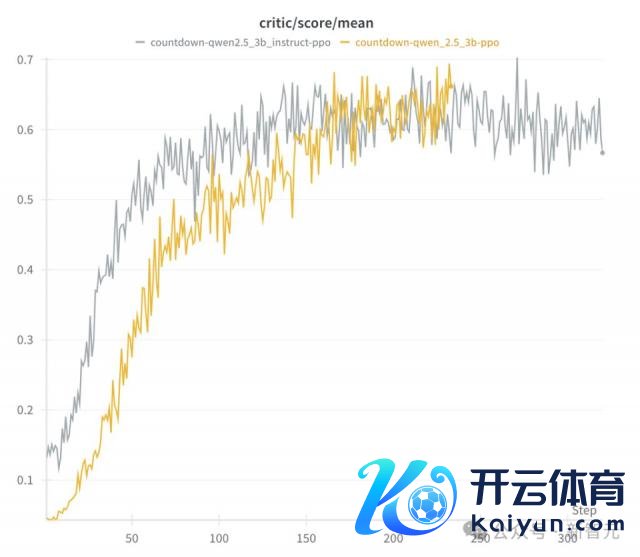

基础模子和指示模子两者区别:

指示模子运行速率快,但最终施展与基础模子特殊

指示输出的模子更具结构性和可读性

此外,他们还发现,具体的 RL 算法并不报复。PPO、GRPO、PRIME 这些算法中,长念念维链(Long CoT)齐能够表露,且带来可以的性能施展。

而且,模子在推理活动中相等依赖于具体的任务:

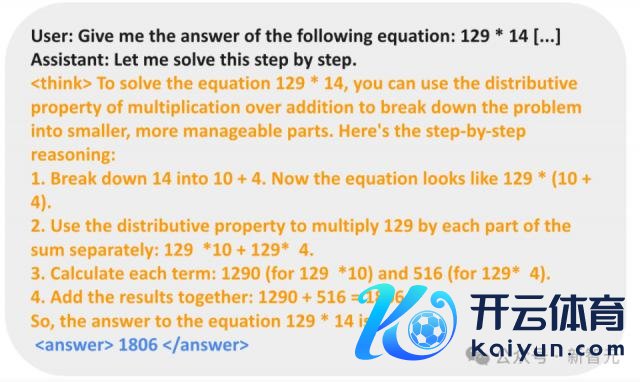

关于 Countdow 任务,模子学习进行搜索和自我考证

关于数字乘法任务,模子反而学习使用分散章程剖析问题,并冉冉处治

苹果机器学习科学家 Yizhe Zhang 对此示意,太酷了,小到 1.5B 的模子,也能通过 RL 表露出自我考证的才气。

7B 模子复刻,限度令东说念主诧异

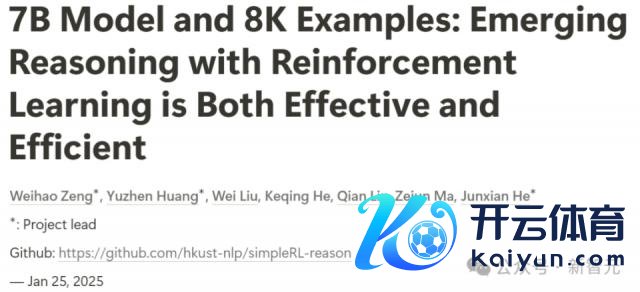

港科大助理教师何俊贤的团队(共归并作黄裕振、Weihao Zeng),只用了 8K 个样本,就在 7B 模子上复刻出了 DeepSeek-R1-Zero 和 DeepSeek-R1 的老到。

限度令东说念主惊喜——模子在复杂的数学推理上取得了十分强盛限度。

款式地址:https://github.com/hkust-nlp/simpleRL-reason

他们以 Qwen2.5-Math-7B(基础模子)为启航点,平直对其进行强化学习。

统共这个词过程中,莫得进行监督微调(SFT),也莫得使用奖励模子。

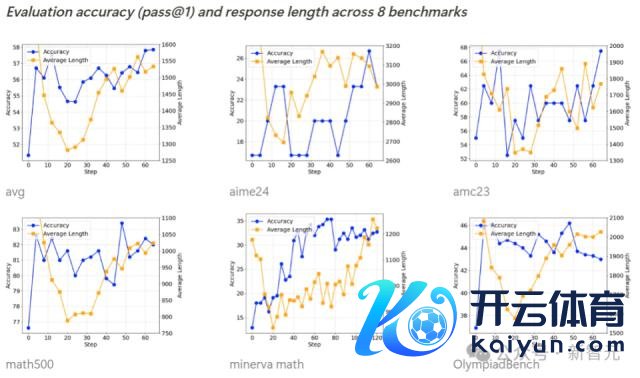

最终,模子在 AIME 基准上罢了了 33.3% 的准确率,在 AMC 上为 62.5%,在 MATH 上为 77.2%。

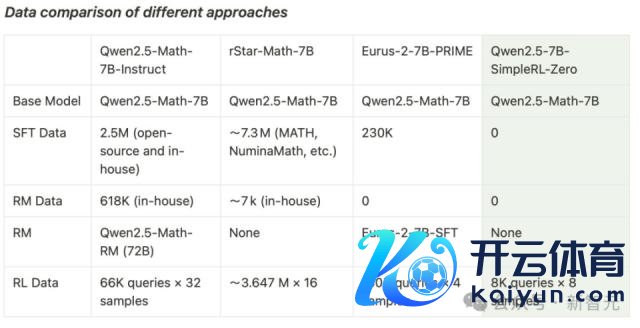

这一施展不仅越过了 Qwen2.5-Math-7B-Instruct,况兼还可以和使用跳动 50 倍数据量和更复杂组件的 PRIME 和 rStar-MATH 相失色!

其中,Qwen2.5-7B-SimpleRL-Zero 是在 Qwen2.5-Math-7B 基础模子上仅使用纯 PPO 步调老到的,仅接受了 MATH 数据聚积的 8K 样本。

Qwen2.5-7B-SimpleRL 则着手通过 Long CoT 监督微调(SFT)算作冷启动,然后再进行强化学习。

在这两种步调中,团队齐只使用了疏导的 8K MATH 样本,仅此良友。

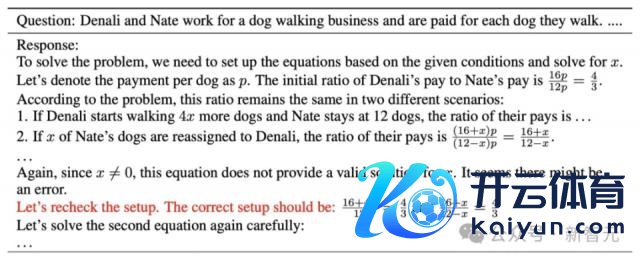

粗略在第 44 步的时期,「啊哈时刻」出现了!模子的反映中,出现了自我反念念。

况兼,在这个过程中,模子还裸露了更长的 CoT 推理才气和自我反念念才气。

在博客中,连续者防护剖析了实际开荒,以及在这个强化学习老到过程中所不雅察到的形势,举例长链式念念考(CoT)和自我反念念机制的自觉酿成。

与 DeepSeek R1 访佛,连续者的强化学习决策极其简便,莫得使用奖励模子或 MCTS(蒙特卡洛树搜索)类期间。

他们使用的是 PPO 算法,并接受基于章程的奖励函数,证实生成输出的阵势和正确性分拨奖励:

如若输出以指定阵势提供最终谜底且正确,取得 +1 的奖励

如若输出提供最终谜底但不正确,奖励设为 -0.5

如若输出未能提供最终谜底,奖励设为 -1

该罢了基于 OpenRLHF。初步锻真金不怕火标明,这个奖励函数有助于战略模子快速不绝,产生适应盼望阵势的输出。

第一部分:SimpleRL-Zero(重新起先的强化学习)

接下来,连续者为咱们共享了老到过程动态分析和一些真谛的表露模式。

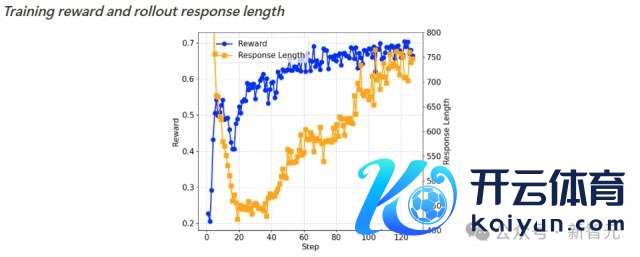

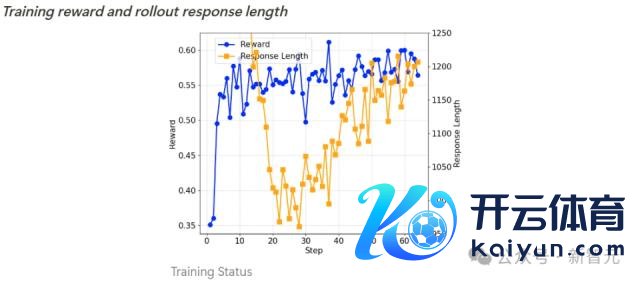

老到过程动态分析

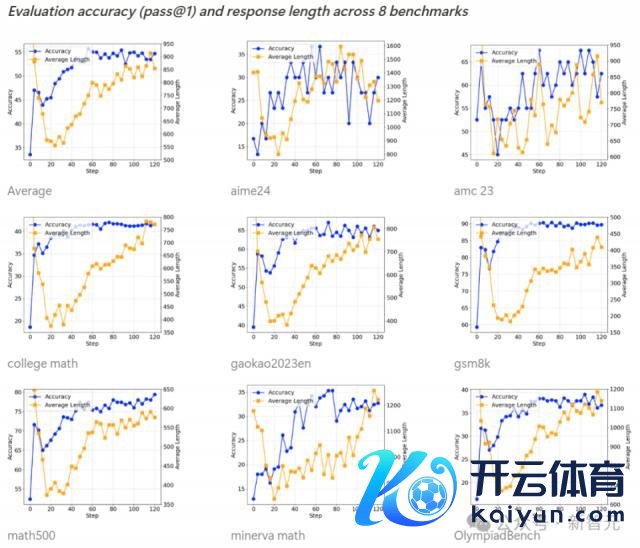

如下所示,统共基准测试的准确率在老到过程中齐在稳步提高,而输出长度则呈现先减少后渐渐增多的趋势。

经过进一步拜谒,连续者发现,Qwen2.5-Math-7B 基础模子在运转阶段倾向于生成多半代码,这可动力于模子原始老到数据的分散特征。

输出长度的初度着落,是因为强化学习老到渐渐根除了这种代码生成模式,转而学会使用当然说话进行推理。

随后,生成长度起先再次增多,此时出现了自我反念念机制。

老到奖励和输出长度

基准测试准确率(pass@1)和输出长度

自我反念念机制的表露

在老到到第 40 步傍边时,连续者不雅察到:模子起先酿成自我反念念模式,这恰是 DeepSeek-R1 论文中所形色的「aha moment」(顿悟时刻)。

第二部分:SimpleRL(基于效法预热的强化学习)

如前所述,连续者在进行强化学习之前,先进行了 long CoT SFT 预热,使用了 8,000 个从 QwQ-32B-Preview 中索求的 MATH 示例反映算作 SFT 数据集。

这种冷启动的潜在上风在于:模子在起先强化学习时已具备 long CoT 念念维模式和自我反念念才气,从而可能在强化学习阶段罢了更快更好的学习成果。

与 RL 老到前的模子(Qwen2.5-Math-7B-Base + 8K QwQ 学问蒸馏版块)比拟,Qwen2.5-7B-SimpleRL 的平均性能显耀耕种了 6.9 个百分点。

此外,Qwen2.5-7B-SimpleRL 不仅握续优于 Eurus-2-7B-PRIME,还在 5 个基准测试中的 3 个上越过了 Qwen2.5-7B-SimpleRL-Zero。

老到过程分析

老到奖励和输出长度

基准测试准确率(pass@1)和输出长度

Qwen2.5-SimpleRL 的老到动态施展与 Qwen2.5-SimpleRL-Zero 雷同。

真谛的是,尽管连续者先进行了 long CoT SFT,但在强化学习初期仍然不雅察到输出长度减少的形势。

他们推测,这可能是因为从 QwQ 索求的推理模式不适应微型战略模子,或超出了其才气畛域。

因此,模子聘请放置这种模式,转而自主发展新的长链式推理方式。

终末,连续者用达芬奇的一句话,对这项连续作念了归来——

节约,等于最终极的玄虚。

统统开源复刻,HuggingFace 下场了

以致,就连大家最打开源平台 HuggingFace 团队,今天官宣复刻 DeepSeek R1 统共 pipeline。

复刻完成后,统共的老到数据、老到剧本等等,将一齐开源。

这个款式叫作念 Open R1,面前还在进行中。发布到一天,星标冲破 1.9k,斩获 142 个 fork。

款式地址:https://github.com/huggingface/open-r1

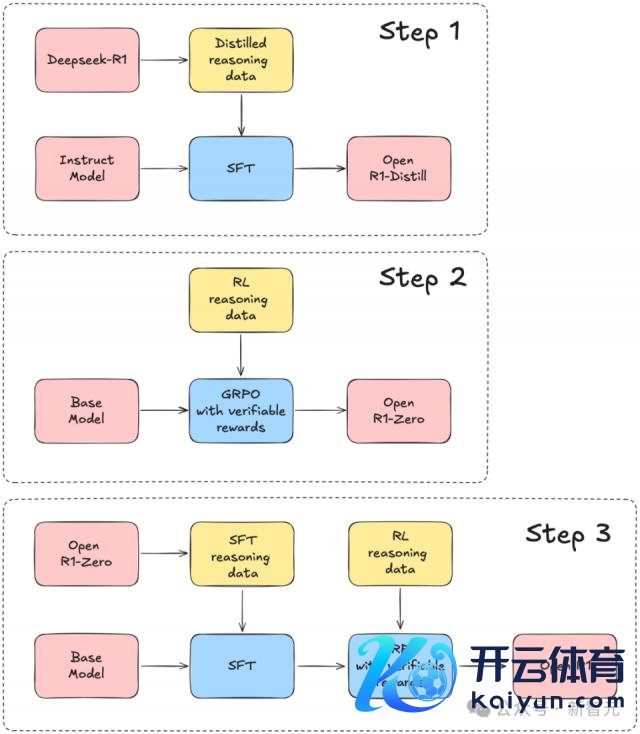

连续团队以 DeepSeek-R1 期间讲明为携带,将统共这个词复刻过程区别为三个关节设施。

设施 1:通过从 DeepSeek-R1 蒸馏高质料语料库,复现 R1-Distill 模子。

设施 2:复现 DeepSeek 用于创建 R1-Zero 的纯强化学习(RL)过程。这可能需要为数学、推理和代码任务运筹帷幄新的大限度数据集。

设施 3:展示咱们怎么通过多阶段老到,从基础模子发展到经过 RL 调优的模子。

从斯坦福到 MIT,R1 成为首选

一个副业款式,让全宇宙科技大厂为之惊悸。

DeepSeek 这波顺利,也成为业界的传奇,网友最新截图炫夸,这款诳骗也曾在 APP Store 诳骗榜单登顶。

在 Hugging Face 中,R1 下载量平直登顶,另外 3 个模子也抢占着热榜。

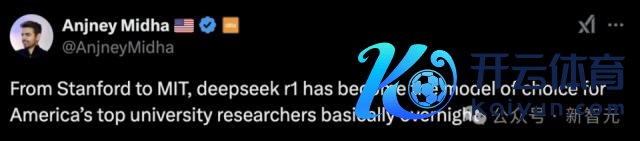

a16z 合资东说念主 Anjney Midha 称,通宵之间,从斯坦福到 MIT,DeepSeek R1 也曾成为好意思国顶尖高校连续东说念主员「首选模子」。

还有连续东说念主员示意,DeepSeek 基本上取代了我用 ChatGPT 的需求。

中国 AI凯时体育游戏app平台,这一次确实触动了宇宙。